티스토리 뷰

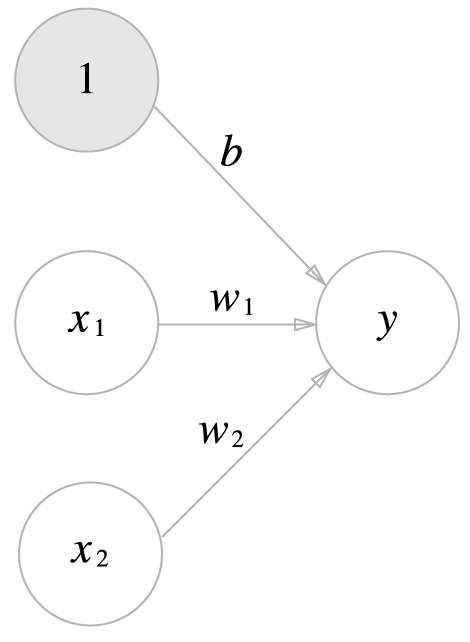

퍼셉트론

- 다수의 신호를 입력으로 받아 하나의 신호를 출력

- w: 가중치, b: 편향

- y 값은 활성화 함수에 의해 결정

다층 신경망

- 퍼셉트론은 직선 하나로 나눈 영역만 표현할 수 있음 (AND, NAND, OR)

- 층을 쌓아 다층 퍼셉트론 구현, 비선형 영역 표현(XOR)

- 입력층, 은닉층, 출력층

참고하면 좋은 유튭 강의 https://youtu.be/z2NN1QQabQs

활성화 함수(activation function)

- 은닉층의 출력 담당

- 입력신호의 총합을 출력 신호로 변환하는 함수

- 입력신호의 총합이 활성화를 일으키는지 결정하는 역할

- 시그모이드함수, 계단함수, ReLU 함수

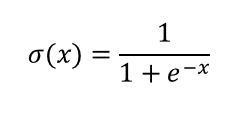

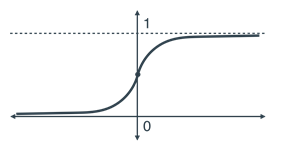

시그모이드 함수

- 비선형 함수

계단함수

- 임계값을 경계로 출력이 바뀜

ReLU(Rectified Linear Unit)

- 입력이 0을 넘으면 그대로 출력, 0이하면 0 출력

출력층

항등 함수

- 입력을 그대로 출력

- 회귀에서 주로 사용

소프트맥스 함수

- 분류에서 주로 사용

- 출력층의 각 뉴런이 모든 입력 신호의 영향을 받음

- 소프트 맥스 함수의 출력을 확률로 해석할 수 있음

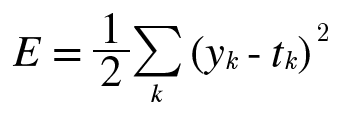

손실함수

- 신경망 성능의 '나쁨'을 나타내는 지표

- 오차제곱합, 교차 엔트로피 오차

오차제곱합

- yk: 신경망의 출력(추정 값), tk: 정받 레이블, k: 데이터 차원 수

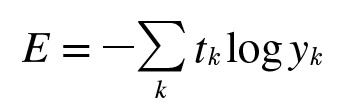

교차 엔트로피 오차

- tk는 정답에 해당하는 인덱스의 원소만 1이고 나머지는 0(원-핫 인코딩)

- 정답일 때의 추정(tk가 1일 때의 yk)의 자연로그 계산 식

수치미분-편미분

기울기- 경사법

오차역전파법-국소적 계산, 연쇄법칙